Les applications de rencontres en ligne sont depuis longtemps un foyer d'escroqueries amoureuses et amoureuses. Les cybercriminels se donnent beaucoup de mal pour voler de l'argent, des informations personnelles et des photos personnelles. Vous trouverez leurs faux profils partout.

Et avec la prolifération des outils d'IA générative, la fraude émotionnelle et amoureuse devient plus facile à réaliser. Ils abaissent les barrières à l'entrée. Voici quelques façons courantes dont les fraudeurs exploitent l'IA, ainsi que la façon de vous protéger. Vérifier Les raisons pour lesquelles les problèmes de sécurité de l'IA générative s'aggravent.

1. Envoyez des e-mails générés par l'IA

Il devient de plus en plus difficile de filtrer les spams. Les escrocs sentimentaux et amoureux abusent des outils d'IA génératifs pour écrire des messages trompeurs et persuasifs et créer plusieurs comptes en quelques minutes. Le fraudeur est capable d'approcher des centaines presque instantanément.

Vous verrez des messages de spam générés par l'IA sur de nombreuses plates-formes, pas seulement dans votre boîte de réception. Prenez l'arnaque au mauvais numéro comme exemple. L'escroc envoie de jolis selfies ou des photos suggestives en masse. Et si quelqu'un répondait, il serait considéré comme une victime innocente.

Une fois que quelqu'un se connecte, il sera redirigé vers une autre plate-forme de messagerie (par exemple, WhatsApp ou Telegram). La plupart des graphiques durent des semaines. L'escroc établit progressivement la confiance avant de demander aux cibles de se joindre à des plans d'investissement, de les aider à payer leurs factures ou de payer des vols.

Restez en sécurité en évitant complètement le spam. Minimisez vos interactions avec les étrangers, peu importe leur apparence ou ce qu'ils ont à offrir.

2. Répondez rapidement à plus de conversations

Les chatbots se sont répandus comme une traînée de poudre sur Internet. signalé Imperva Les bad bots représentaient 30 % du trafic automatisé du Web en 2022. Vous en trouverez un quelques secondes après avoir parcouru les pages Tinder.

L'une des raisons de cette augmentation soudaine des bots est la prolifération des outils d'IA générative. Ce qui permet de développer des robots en grande quantité. Entrez simplement l'invite correcte et votre outil fournira un extrait de code complet et puissant pour créer des bots.

Sachez quand parler à un bot. Bien que l'IA utilise un ton conversationnel naturel, son dialogue est toujours monotone et maladroit. Après tout, les chatbots ne suivent que des modèles. Vous pouvez produire des réponses similaires à différentes questions, déclarations et demandes.

3. Créer plusieurs identités à partir des photos volées

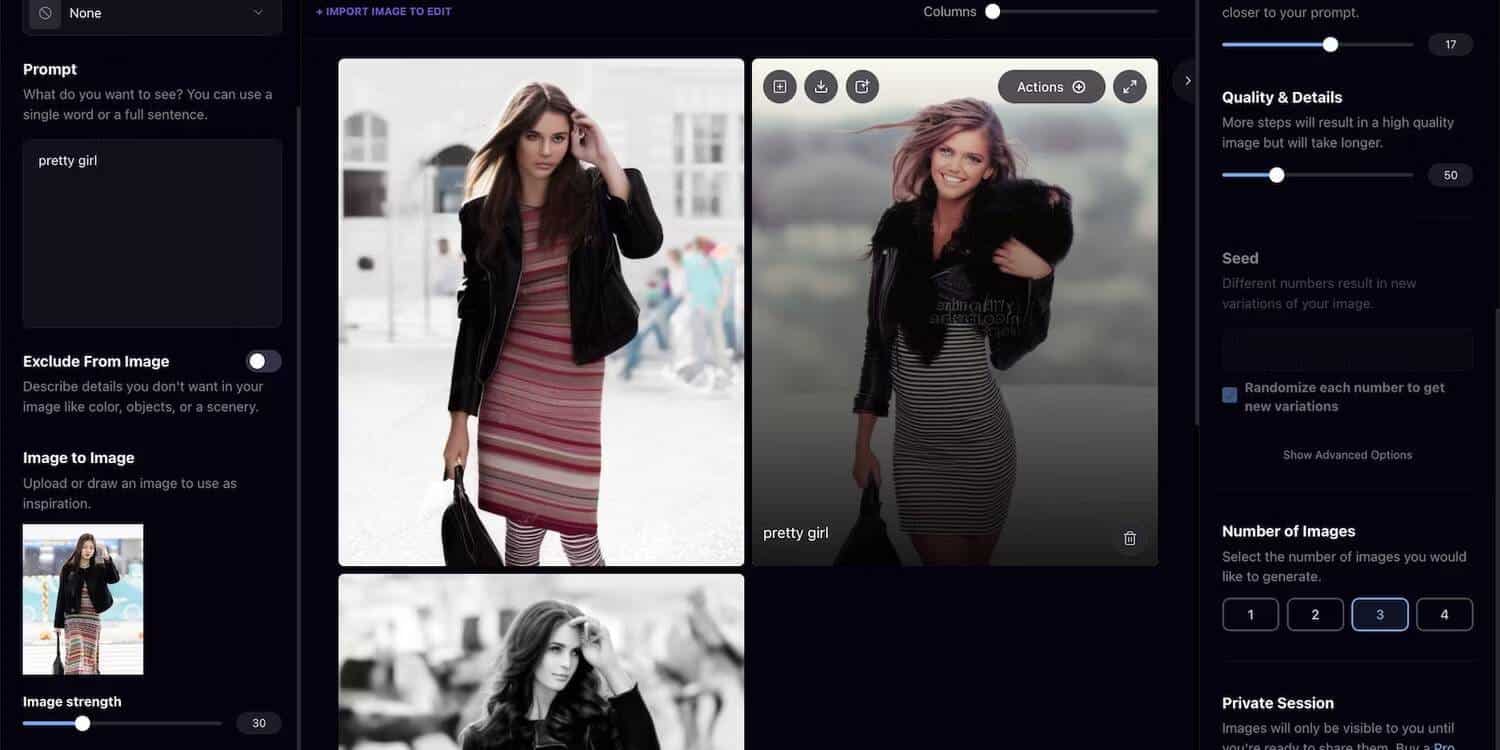

Les générateurs d'art d'intelligence artificielle manipulent des images. Prenez la démo ci-dessous comme exemple. Nous avons fourni à Playground AI une photo claire d'un chanteur célèbre - la plate-forme a généré trois looks différents en quelques secondes.

Oui, il a quelques défauts. Mais notez que nous avons utilisé un outil gratuit qui exécute un ancien modèle pour convertir les invites de texte en image. Le filou produit une sortie plus réaliste avec des itérations complexes. Il peut afficher rapidement des centaines d'images personnalisées et traitées à partir de quelques échantillons seulement.

Malheureusement, les images AI sont difficiles à détecter. Votre meilleur pari serait d'effectuer une recherche d'image inversée et d'affiner les résultats pertinents. Vérifier Qu'est-ce que DALL-E et comment les images sont-elles générées à partir de descriptions textuelles ?

4. Créez des comptes frauduleux authentiques

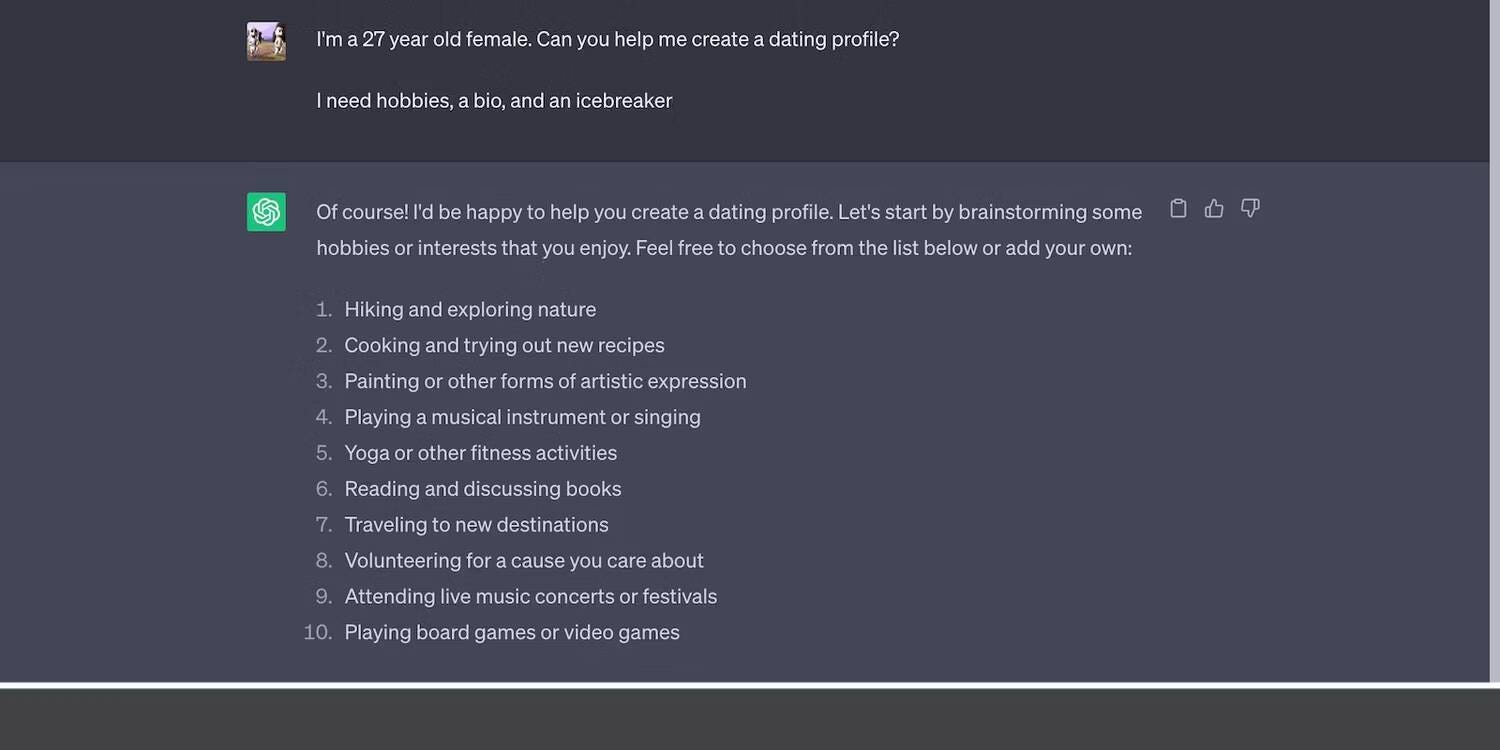

Les bots approchent les victimes en masse. Ainsi, une personne utilisant une escroquerie romantique préférerait un schéma ciblé dans lequel elle ne créerait qu'un ou deux profils avec de vrais looks. Il utilisera l'intelligence artificielle pour paraître convaincant. Les outils d'IA générative peuvent composer des descriptions authentiques qui semblent naturelles et réelles ; La mauvaise grammaire ne sera plus un problème.

Voici ChatGPT suggérant quelques passe-temps à inclure dans votre profil de rencontre.

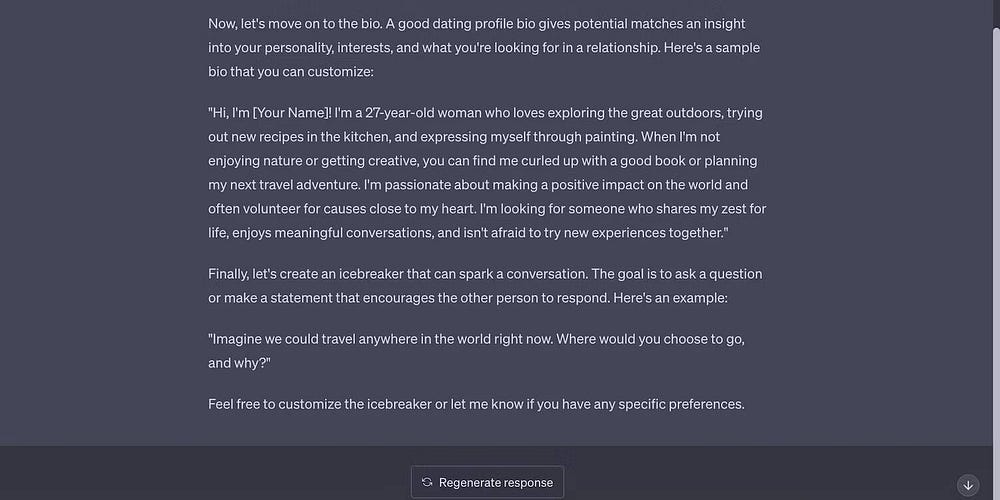

Voici ChatGPT écrire une biographie complète pour le profil de rencontre.

Étant donné que ce processus prend beaucoup de temps, il nécessite également un rendement plus élevé. Par conséquent, le fraudeur a tendance à en demander plus. Une fois qu'il aura gagné votre confiance, il demandera de l'aide pour divers "problèmes", tels que le paiement des factures d'hôpital, le remboursement des prêts ou les frais de scolarité. Quelqu'un peut prétendre qu'il vous rendra visite si vous payez son billet.

Ces cybercriminels sont habiles à manipuler les victimes. La meilleure approche consiste à éviter de les traiter dès le départ. Ne les laissez pas dire n'importe quoi. Sinon, vous risquez de tomber progressivement dans leur tromperie et leurs méthodes de manipulation.

5. Exploiter les deepfakes à des fins d'extorsion sexuelle

Les outils d'IA deepfake évoluent à un rythme alarmant. Les nouvelles technologies réduisent considérablement les défauts mineurs des fausses vidéos, tels que le scintillement non naturel, les tons de peau inégaux, le son déformé et les éléments incohérents.

Malheureusement, ces erreurs agissent également comme des signes avant-coureurs. Permettre aux utilisateurs de les supprimer rend difficile la distinction entre les vidéos légitimes et fausses.

Bloomberg montre comment une personne possédant des connaissances techniques de base peut manipuler sa voix et ses visuels pour reproduire l'apparence des autres. Vérifier Les principaux risques des deepfakes et comment les repérer.

En plus de créer des comptes de rencontres réalistes, l'escroc exploite les deepfakes pour la sextorsion. Où il mélange des photos et des vidéos publiques avec de la pornographie. Après avoir manipulé le contenu illégal, il fera chanter les victimes et exigera de l'argent, des données personnelles ou des services sexuels.

N'abandonnez pas si vous êtes ciblé. Appelez le 1-800-FBI, contactez n'importe quel bureau d'application de la loi ou visitez votre bureau de police local si vous vous trouvez dans cette situation.

6. Intégration de modèles d'intelligence artificielle avec des systèmes de piratage pour accéder aux mots de passe

Bien que les paradigmes de langage open source prennent en charge certaines avancées de l'IA, ils sont également vulnérables à l'exploitation. Le criminel exploitera tout ce à quoi il pourra avoir accès. Vous ne pouvez pas vous attendre à ce qu'il ignore l'algorithme derrière des paradigmes de langage très complexes comme LLaMA et OpenAssistant.

Dans les escroqueries amoureuses, le pirate combine souvent des modèles linguistiques avec le piratage de mots de passe. Les capacités d'apprentissage automatique et d'apprentissage en profondeur de l'IA permettent à de puissants systèmes de piratage de générer des combinaisons de mots de passe rapidement et efficacement. Il peut même faire des prédictions éclairées si suffisamment de contexte est fourni.

Vous n'avez aucun contrôle sur ce que fait le fraudeur. Pour protéger vos comptes, assurez-vous de créer un mot de passe vraiment sécurisé composé de caractères spéciaux, de combinaisons alphanumériques et de plus de 14 caractères. Vérifier Comment fonctionne un piratage de mot de passe ? Ce qu'il faut savoir.

7. Imitez de vraies personnes en clonant leur voix

AI Sound Generators a commencé comme un grand jeu. L'utilisateur convertit les échantillons des morceaux de son artiste préféré en chansons ou même en nouvelles chansons. Prenez Heart on my sleeve comme exemple. L'utilisateur de TikTok, Ghostwriter977, a créé une chanson super réaliste imitant Drake et The Weeknd, même si aucun des deux artistes ne l'a chantée.

Malgré les blagues et les mèmes qui l'entourent, les synthétiseurs sont très dangereux. Il permet aux criminels de mener des attaques sophistiquées. Par exemple, la fraude amoureuse exploite des outils de clonage audio pour appeler des cibles et laisser des enregistrements trompeurs. Les victimes qui ne connaissent pas la syntaxe de la parole ne remarqueront rien d'inhabituel.

Protégez-vous du clonage audio AI en étudiant la façon dont l'audio de sortie est synthétisé. Découvrez ces générateurs. Cela crée simplement des copies presque identiques - vous remarquerez toujours des défauts et des incohérences. Vérifier Façons dont les gouvernements peuvent réglementer les outils d'IA.

Protégez-vous des escrocs de l"IA lors de rencontres

Au fur et à mesure que les outils d'IA générative progressent, les escroqueries émotionnelles développeront de nouvelles façons de les exploiter. Les développeurs ne peuvent pas arrêter ces criminels. Jouez un rôle proactif dans la lutte contre la cybercriminalité plutôt que de simplement faire confiance aux restrictions de sécurité pour fonctionner. Vous pouvez toujours utiliser des applications de rencontres. Mais assurez-vous de connaître la personne de l'autre côté de l'écran avant de vous engager avec elle.

Et faites attention aux autres schémas alimentés par l'IA. Outre les escroqueries amoureuses, les criminels utilisent l'intelligence artificielle pour le vol d'identité, la cyber-extorsion, les attaques de rançongiciels et le piratage violent. Apprenez également à combattre ces menaces. Vous pouvez voir maintenant Erreurs à éviter lors de l'utilisation d'outils d'IA générative.