Las aplicaciones de citas en línea han sido durante mucho tiempo un semillero de romances y estafas románticas. Los ciberdelincuentes hacen todo lo posible para robar dinero, información personal y fotos personales. Encontrarás sus perfiles falsos en todas partes.

Y con la proliferación de herramientas de inteligencia artificial generativa, el fraude emocional y romántico se está volviendo más fácil de lograr. Reducen las barreras de entrada. Aquí hay algunas formas comunes en que los estafadores explotan la IA, además de cómo protegerse. Verificar Las razones por las que los problemas de seguridad de la IA generativa están empeorando.

1. Envía correos electrónicos generados por IA

Cada vez es más difícil filtrar los correos electrónicos no deseados. Los estafadores sentimentales y románticos abusan de las herramientas generativas de IA para escribir mensajes engañosos y persuasivos y crear múltiples cuentas en cuestión de minutos. El estafador puede acercarse a cientos casi instantáneamente.

Verá mensajes de spam generados por IA en muchas plataformas, no solo en su bandeja de entrada de correo electrónico. Tome la estafa del número equivocado como ejemplo. El estafador envía lindas selfies o fotos sugerentes de forma masiva. Y si alguien respondía, sería considerado una víctima inocente.

Una vez que alguien se conecta, será llevado a otra plataforma de mensajería (por ejemplo, WhatsApp o Telegram). La mayoría de los gráficos duran semanas. El estafador gradualmente genera confianza antes de pedirles a los objetivos que se unan a los planes de inversión, que los ayuden a pagar sus facturas o que paguen los vuelos.

Manténgase seguro evitando el spam por completo. Minimice sus interacciones con extraños, sin importar cómo se vean o qué tengan para ofrecer.

2. Responda a más conversaciones rápidamente

Los chatbots se propagan como la pólvora en Internet. reportado Imperva Los bots maliciosos representaron el 30 % del tráfico automatizado de la web en 2022. Encontrará uno a los pocos segundos de navegar por las páginas de Tinder.

Una de las razones de este aumento repentino de los bots es la proliferación de herramientas de IA generativa. Lo que ayuda a desarrollar robots en grandes cantidades. Simplemente ingrese el indicador correcto y su herramienta le entregará un fragmento de código completo y poderoso para crear bots.

Sepa cuándo hablar con un bot. Aunque la IA utiliza un tono conversacional natural, su diálogo sigue siendo monótono e incómodo. Después de todo, los chatbots solo siguen patrones. Puede producir respuestas similares a diferentes preguntas, declaraciones y solicitudes.

3. Crear múltiples identidades a partir de las fotos robadas

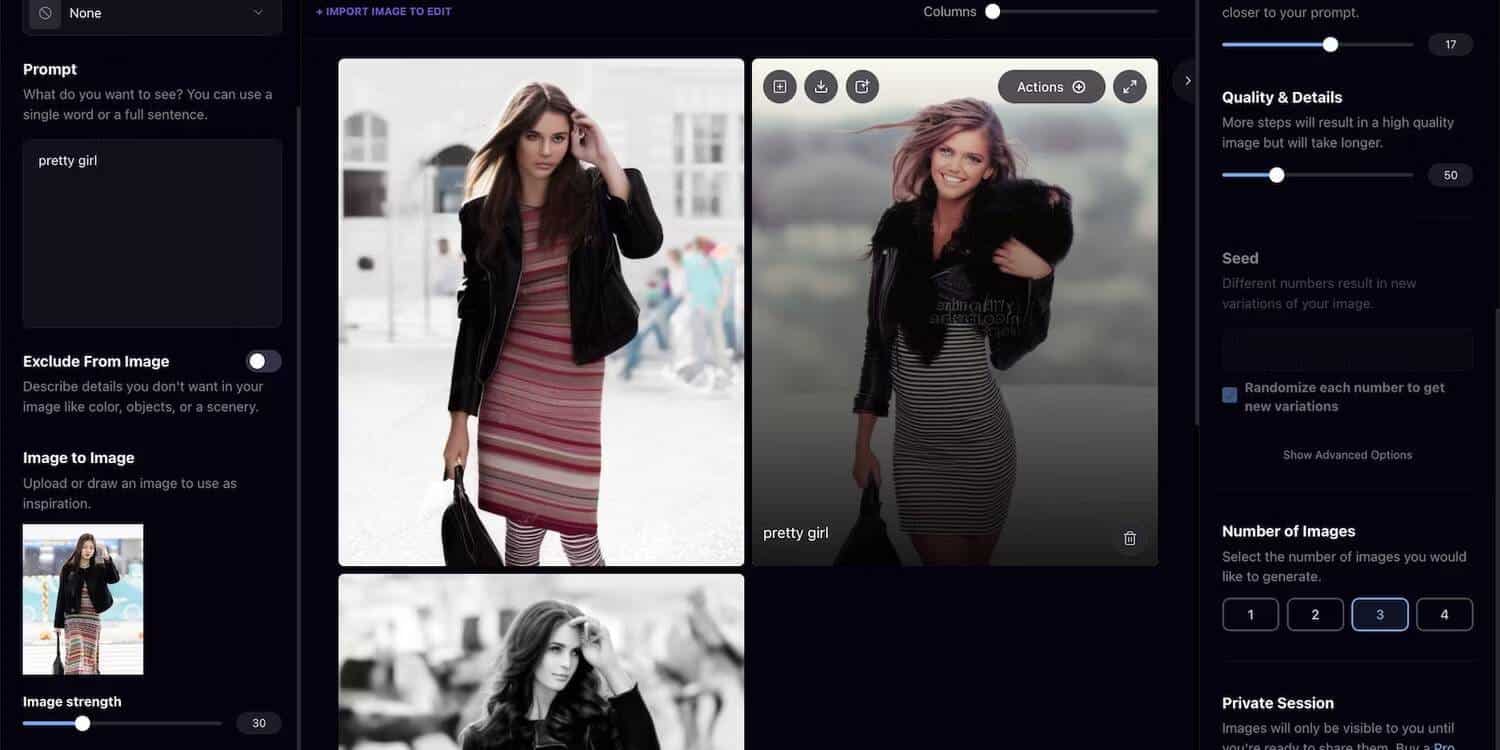

Los generadores de arte de inteligencia artificial manipulan imágenes. Tome la demostración a continuación como ejemplo. Le dimos a Playground AI una foto clara de un cantante famoso: la plataforma generó tres looks diferentes en cuestión de segundos.

Sí, tiene algunos defectos. Pero tenga en cuenta que usamos una herramienta gratuita que ejecuta un modelo antiguo para convertir mensajes de texto en una imagen. El tramposo produce resultados más realistas con iteraciones complejas. Puede mostrar rápidamente cientos de imágenes personalizadas y procesadas a partir de unas pocas muestras.

Desafortunadamente, las imágenes de IA son difíciles de detectar. Su mejor opción sería realizar una búsqueda inversa de imágenes y refinar los resultados relevantes. Verificar ¿Qué es DALL-E y cómo se crean imágenes a partir de descripciones de texto?

4. Cree cuentas fraudulentas que parezcan auténticas

Los bots se acercan a las víctimas en masa. Entonces, una persona que usa una estafa romántica preferiría un esquema dirigido en el que solo crea uno o dos perfiles de apariencia real. Utilizará inteligencia artificial para parecer convincente. Las herramientas de IA generativa pueden componer descripciones de aspecto auténtico que parecen naturales y reales; La mala gramática ya no será un problema.

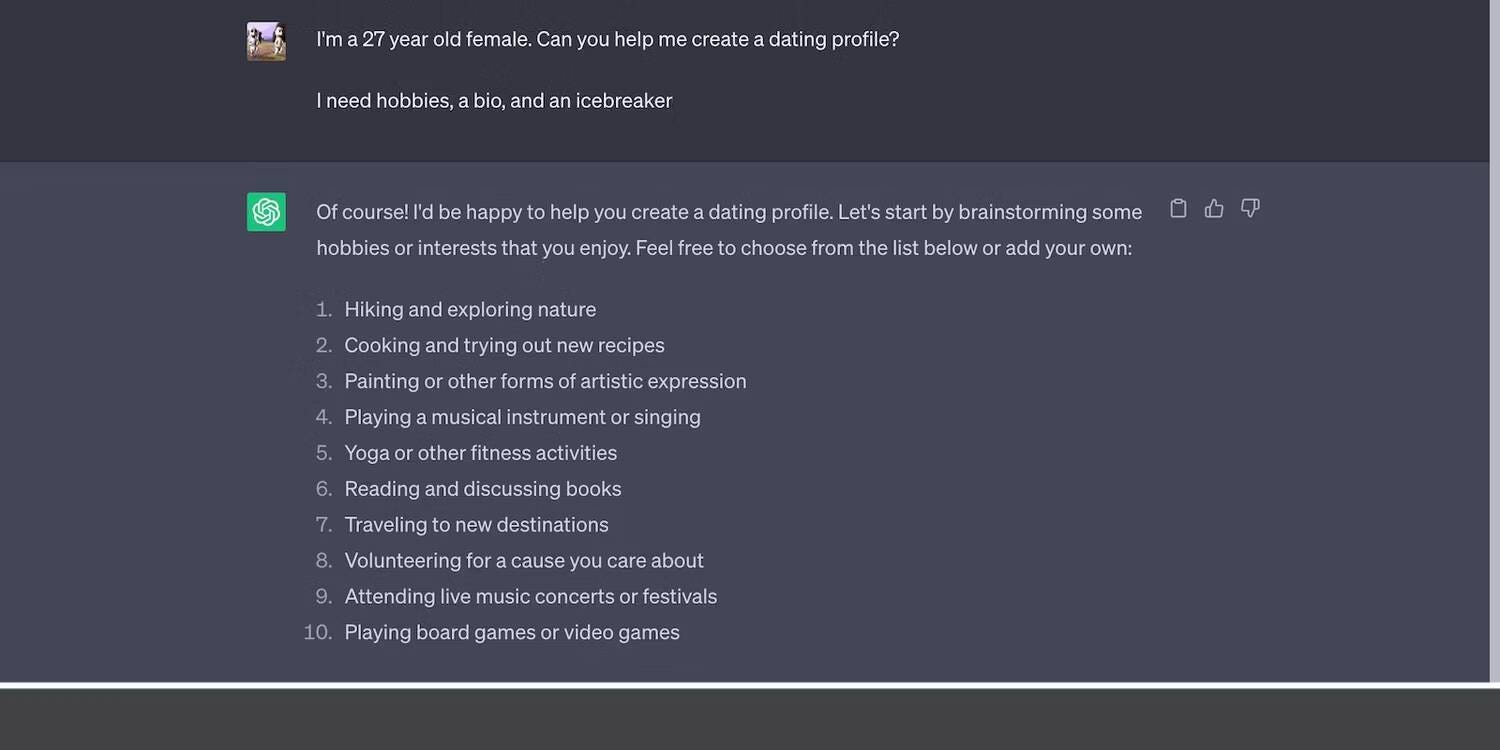

Aquí está ChatGPT sugiriendo algunos pasatiempos para incluir en su perfil de citas.

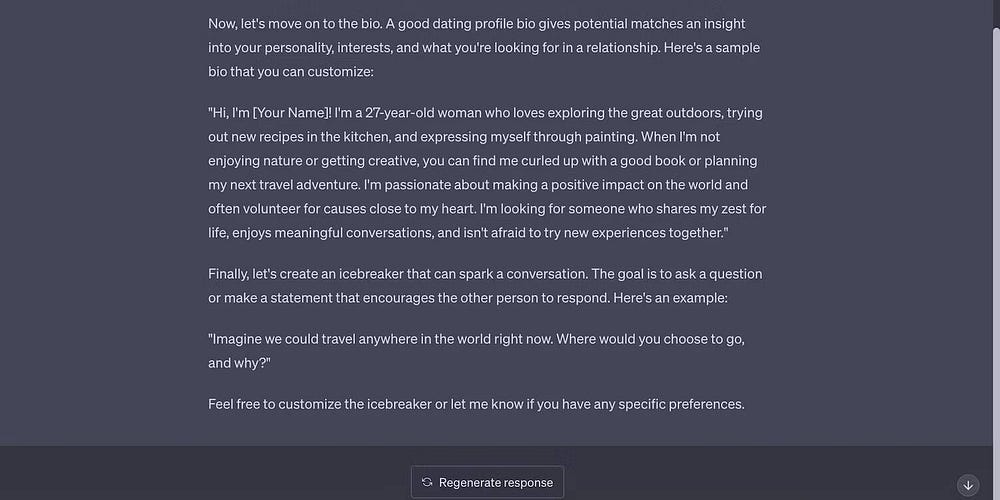

Aquí está ChatGPT, escriba una biografía completa para el perfil de citas.

Dado que este proceso lleva mucho tiempo, también requiere un mayor rendimiento. Por lo tanto, el estafador tiende a pedir más. Una vez que se haya ganado su confianza, le pedirá ayuda con varios "problemas", como el pago de las facturas del hospital, pagos de préstamos o tasas de matrícula. Alguien puede afirmar que lo visitará si paga su boleto.

Estos ciberdelincuentes son expertos en manipular a las víctimas. El mejor enfoque es evitar tratar con ellos desde el principio. No dejes que digan nada. De lo contrario, puede caer gradualmente en sus engaños y métodos manipuladores.

5. Explotación de deepfakes para la extorsión sexual

Las herramientas de falsificación profunda de IA están evolucionando a un ritmo alarmantemente rápido. Las nuevas tecnologías reducen profundamente las fallas menores en los videos falsos, como el parpadeo no natural, los tonos de piel desiguales, el audio distorsionado y los elementos inconsistentes.

Desafortunadamente, estos errores también actúan como señales de advertencia. Permitir que los usuarios los eliminen dificulta la distinción entre videos legítimos y falsos.

Bloomberg muestra cómo una persona con conocimientos técnicos básicos puede manipular su voz y sus imágenes para replicar la apariencia de los demás. Verificar Los principales riesgos de la tecnología deepfake y cómo detectarlos.

Además de crear cuentas de citas realistas, el estafador explota los deepfakes para la sextorsión. Donde mezcla fotos y videos públicos con pornografía. Después de manipular el contenido ilegal, chantajeará a las víctimas y exigirá dinero, datos personales o servicios sexuales.

No te rindas si eres un objetivo. Llame al 1-800-FBI, comuníquese con cualquier oficina de aplicación de la ley o visite la oficina de policía local si se encuentra en esta situación.

6. Integración de modelos de inteligencia artificial con sistemas de hacking para acceder a contraseñas

Si bien los paradigmas de lenguaje de código abierto respaldan algunos avances en IA, también son vulnerables a la explotación. El criminal explotará cualquier cosa a la que pueda tener acceso. No puede esperar que ignore el algoritmo detrás de paradigmas de lenguaje altamente complejos como LLaMA y OpenAssistant.

En las estafas románticas, el hacker a menudo combina modelos de lenguaje con la piratería de contraseñas. Las capacidades de aprendizaje automático y aprendizaje profundo de la IA permiten que los potentes sistemas de piratería generen combinaciones de contraseñas de forma rápida y eficiente. Incluso puede hacer predicciones informadas si se proporciona suficiente contexto.

No tienes control sobre lo que hace el estafador. Para proteger sus cuentas, asegúrese de crear una contraseña realmente segura que esté compuesta por caracteres especiales, combinaciones alfanuméricas y más de 14 caracteres. Verificar ¿Cómo funciona un hackeo de contraseña? Qué saber.

7. Imita a personas reales clonando su voz

AI Sound Generators comenzó como un gran juego. El usuario convierte muestras de las pistas de su artista favorito en canciones o incluso en canciones nuevas. Tome Corazón en mi manga como ejemplo. El usuario de TikTok Ghostwriter977 hizo una canción súper realista imitando a Drake y The Weeknd, aunque ninguno de los artistas la cantó.

A pesar de las bromas y los memes que lo rodean, los sintetizadores son muy peligrosos. Permite a los delincuentes llevar a cabo ataques sofisticados. Por ejemplo, el fraude romántico explota las herramientas de clonación de audio para llamar a los objetivos y dejar grabaciones engañosas. Las víctimas que no estén familiarizadas con la sintaxis del habla no notarán nada inusual.

Protéjase de la clonación de audio de IA estudiando cómo se sintetiza el audio de salida. Explora estos generadores. Simplemente crea copias casi idénticas; aún detectará algunos defectos e inconsistencias. Verificar Formas en que los gobiernos pueden regular las herramientas de IA.

Protéjase de los estafadores de IA mientras tiene citas

A medida que avanzan las herramientas generativas de IA, las estafas emocionales desarrollarán nuevas formas de explotarlas. Los desarrolladores no pueden detener a estos delincuentes. Asuma un papel proactivo en la lucha contra el ciberdelito en lugar de simplemente confiar en que las restricciones de seguridad funcionen. Todavía puedes usar aplicaciones de citas. Pero asegúrese de conocer a la persona al otro lado de la pantalla antes de interactuar con ella.

Y tenga cuidado con otros esquemas impulsados por IA. Además de las estafas románticas, los delincuentes utilizan la inteligencia artificial para el robo de identidad, la extorsión cibernética, los ataques de ransomware y la piratería informática violenta. Aprenda también a combatir estas amenazas. Puedes ver ahora Errores a evitar al usar herramientas de IA generativa.