ارتفعت شعبية روبوتات الدردشة بالذكاء الاصطناعي بشكل مُطرد بين جميع المُستخدمين. في حين أنَّ قدراتها مثيرة للإعجاب ، فمن المهم أن ندرك أنَّ روبوتات الدردشة ليست خالية من العيوب والقيود. هناك مخاطر مُتأصلة مُرتبطة بها ، مثل مخاوف الخصوصية والهجمات الإلكترونية المُحتملة. من الضروري توخي الحذر عند التعامل مع روبوتات الدردشة.

دعنا نستكشف المخاطر المُحتملة لمشاركة المعلومات مع روبوتات الدردشة بالذكاء الاصطناعي ونرى أنواع المعلومات التي لا ينبغي الكشف عنها لها. تحقق من العوامل الرئيسية التي يجب مراعاتها عند اختبار روبوتات الدردشة بالذكاء الاصطناعي للتأكد من دقتها.

المخاطر التي ينطوي عليها استخدام روبوتات الدردشة بالذكاء الاصطناعي

تُمثل مخاطر الخصوصية ونقاط الضعف المُرتبطة بروبوتات الدردشة AI مخاوف أمنية كبيرة للمُستخدمين. قد يُفاجئك ذلك ، لكن أدوات الدردشة الودودة مثل ChatGPT و Bard و Bing AI وغيرها يُمكنها كشف معلوماتك الشخصية عن غير قصد عبر الإنترنت. تعتمد روبوتات الدردشة هذه على نماذج اللغات الكبيرة (LLMs) ، والتي تستمد رؤى من بياناتك.

على سبيل المثال ، ينص الإصدار الحالي من Google Bard ، صراحةً في صفحة الأسئلة الشائعة الخاصة به على أنه يجمع بيانات المحادثة ويستخدمها لتدريب نموذجه. وبالمثل ، فإنَّ ChatGPT لديه أيضًا مشكلات تتعلق بالخصوصية حيث يمكنه الاحتفاظ بسجلات الدردشة لتحسين النموذج. لكنه يُوفر خيارًا للانسحاب.

نظرًا لأنَّ روبوتات الدردشة AI تُخزِن البيانات على الخوادم ، فإنها تصبح عرضة لمحاولات القرصنة. تحتوي هذه الخوادم على ثروة من المعلومات التي يمكن لمجرمي الإنترنت استغلالها بطرق مختلفة. يُمكنهم التسلل إلى الخوادم وسرقة البيانات وبيعها في أسواق الويب المُظلمة. بالإضافة إلى ذلك ، يمكن للمتسللين الاستفادة من هذه البيانات لاختراق كلمات السر والحصول على وصول غير مصرح به إلى أجهزتك. تحقق من هل لدى ChatGPT مُشكلات تتعلق بالخصوصية؟

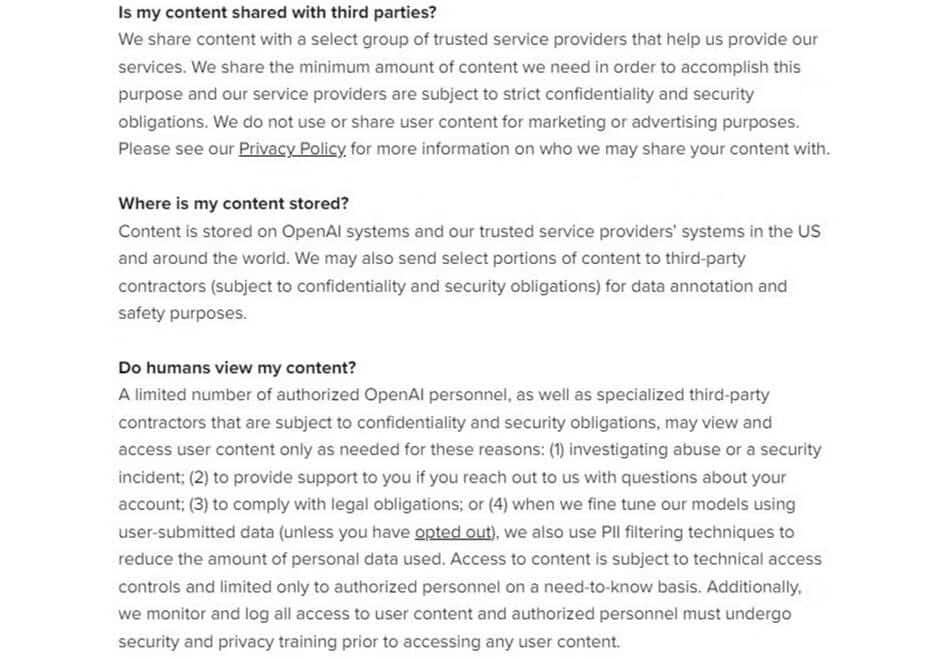

علاوة على ذلك ، لا يقتصر استخدام البيانات الناتجة عن تفاعلاتك مع روبوتات الدردشة بالذكاء الاصطناعي على الشركات المعنية وحدها. بينما تُؤكد أنَّ البيانات لا تُباع لأغراض الدعاية أو التسويق ، تتم مشاركتها مع جهات خارجية معينة لمتطلبات صيانة النظام.

تُقر شركة OpenAI ، المؤسسة التي المُطورة لـ ChatGPT ، بأنها تشارك البيانات مع “مجموعة مختارة من مُزودي الخدمة الموثوق بهم” وأنَّ بعض “موظفي OpenAI المُعتمدين” قد يكون لديهم حق الوصول إلى البيانات. تُثير هذه الممارسات مزيدًا من المخاوف الأمنية المُحيطة بتفاعلات روبوت الدردشة بالذكاء الاصطناعي ، حيث يجادل النقاد بأنَّ المخاوف الأمنية المتعلقة بالذكاء الاصطناعي قد تزداد سوءًا.

لذلك ، فإن حماية المعلومات الشخصية من روبوتات الدردشة التي تعمل بالذكاء الاصطناعي أمر بالغ الأهمية للحفاظ على خصوصيتك.

ما الذي لا يجب مشاركته مع روبوتات الدردشة بالذكاء الاصطناعي؟

لضمان خصوصيتك وأمانك ، من الضروري اتباع أفضل المُمارسات عند التفاعل مع روبوتات الدردشة التي تعمل بالذكاء الاصطناعي.

1. التفاصيل المالية

هل يُمكن لمجرمي الإنترنت استخدام روبوتات الدردشة المدعومة بالذكاء الاصطناعي مثل ChatGPT لاختراق حسابك المصرفي؟ مع الاستخدام الواسع النطاق لروبوتات الدردشة ، لجأ العديد من المُستخدمين إلى نماذج اللغة هذه للحصول على المشورة المالية وإدارة الشؤون المالية الشخصية. في حين أنها يمكن أن تُعزز الثقافة المالية ، فمن الأهمية بمكان معرفة المخاطر المحتملة لمشاركة التفاصيل المالية مع روبوتات الدردشة التي تعمل بالذكاء الاصطناعي.

عند استخدام روبوت الدردشة كمُستشار مالي ، فإنك تُخاطر بتعريض معلوماتك المالية لمجرمي الإنترنت المُحتملين الذين يمكنهم استغلالها لاستنزاف حساباتك. على الرغم من ادِّعاء الشركات بإخفاء بيانات المحادثة ، قد يظل بإمكان الأطراف الثالثة وبعض الموظفين الوصول إليها. يُثير هذا مخاوف بشأن التنميط ، حيث يمكن استخدام تفاصيلك المالية لأغراض ضارة مثل حملات برامج الفدية أو بيعها لوكالات التسويق.

لحماية معلوماتك المالية من روبوتات الدردشة بالذكاء الاصطناعي ، يجب أن تضع في اعتبارك ما تُشاركه مع نماذج الذكاء الاصطناعي التوليدي هذه. يُنصح بالحد من تفاعلاتك للحصول على معلومات عامة وطرح أسئلة عامة. إذا كنت بحاجة إلى مشورة مالية مُخصصة ، فقد تكون هناك خيارات أفضل من الاعتماد فقط على نماذج الذكاء الاصطناعي. قد تُقدم معلومات غير دقيقة أو مُضللة ، مما قد يُعرض أموالك التي كسبتها بشق الأنفس للخطر. بدلاً من ذلك ، فكر في طلب المشورة من مستشار مالي مُرخص يُمكنه تقديم إرشادات موثوقة ومُصممة خصيصًا لاستفساراتك.

2. أفكارك الشخصية والحميمة

يلجأ العديد من المُستخدمين إلى روبوتات الدردشة بالذكاء الاصطناعي للبحث عن العلاج أو حل للمشاكل الشخصية ، غير مُدركين للعواقب المحتملة على صحتهم العقلية. يُعد فهم مخاطر الكشف عن المعلومات الشخصية والحميمة لروبوتات الدردشة هذه أمرًا ضروريًا.

أولاً ، تفتقر روبوتات الدردشة إلى المعرفة الواقعية ويُمكنها فقط تقديم ردود عامة على الاستفسارات المُتعلقة بالصحة العقلية. هذا يعني أنَّ الأدوية أو العلاجات التي تقترحها قد لا تكون مناسبة لاحتياجاتك الخاصة ويُمكن أن تضر بصحتك.

علاوة على ذلك ، فإنَّ مشاركة الأفكار الشخصية مع روبوتات الدردشة التي تعمل بالذكاء الاصطناعي تُثير مخاوف كبيرة بشأن الخصوصية. قد يتم اختراق خصوصيتك باعتبارها أسرارك ، ويمكن تسريب الأفكار الحميمة عبر الإنترنت. يُمكن للمُتسللين استغلال هذه المعلومات للتجسس عليك أو بيع بياناتك على الويب المظلم أو حتى تهديدك. لذلك ، فإنَّ حماية خصوصية الأفكار الشخصية عند التفاعل مع روبوتات الدردشة أمر في غاية الأهمية.

من الأهمية بمكان التعامل مع روبوتات الدردشة كأدوات للمعلومات العامة والدعم بدلاً من أن تكون بديلاً للعلاج المهني. إذا كنت بحاجة إلى مشورة أو علاج في مجال الصحة العقلية ، فمن المستحسن دائمًا استشارة أخصائي صحة نفسية مؤهل. يُمكنهم تقديم إرشادات شخصية وموثوقة مع إعطاء الأولوية لخصوصيتك ورفاهيتك. تحقق من أسباب للنظر في استخدام ChatGPT للحصول على نصائح صحية.

3. المعلومات السرية الخاصة بمكان عملك

هناك خطأ آخر يجب على المُستخدمين تجنبه عند التفاعل مع روبوتات الدردشة وهو مشاركة المعلومات السرية المُتعلقة بالعمل. حتى شركات التكنولوجيا العمالقة مثل Apple و Samsung و JPMorgan و Google ، مُطورة Bard ، قامت بتقييد موظفيها من استخدام روبوتات الدردشة في مكان العمل.

سلط تقرير بلومبرج الضوء على حالة استخدم فيها موظفو Samsung لـ ChatGPT لأغراض البرمجة وقاموا بتحميل كود برمجي حساس عن غير قصد على منصة نموذج الذكاء الاصطناعي. أدى هذا الحادث إلى الكشف غير المُصرح به عن معلومات سرية حول Samsung ، مما دفع الشركة إلى فرض حظر على استخدام روبوت الدردشة AI. بصفتك مطورًا يسعى للحصول على مساعدة من الذكاء الاصطناعي لحل مشكلات الترميز ، فإنَّ هذا هو السبب الذي يجعلك لا تثق في روبوتات الدردشة مثل ChatGPT لمنحها معلومات سرية. من الضروري توخي الحذر عند مشاركة التعليمات البرمجية الحساسة أو التفاصيل المُتعلقة بالعمل.

وبالمثل ، يعتمد العديد من الموظفين على روبوتات الدردشة لتلخيص محاضر الاجتماعات أو أتمتة المهام المُتكررة ، مما يعرضك لخطر الكشف عن البيانات الحساسة عن غير قصد. وبالتالي ، فإنَّ الحفاظ على خصوصية معلومات العمل السرية والامتناع عن مشاركتها مع روبوتات الدردشة التي تعمل بالذكاء الاصطناعي أمر في غاية الأهمية.

يُمكن للمستخدمين حماية معلوماتهم الحساسة وحماية مؤسساتهم من التسريبات غير المقصودة أو انتهاكات البيانات من خلال الانتباه إلى المخاطر المرتبطة بمشاركة البيانات المتعلقة بالعمل. تحقق من أخلاقيات البيانات: قواعد السلوك التي يجب على كل عالم بيانات اتباعها.

4. كلمات السر

من الأهمية بمكان التأكيد على أنَّ مشاركة كلمات سرك على الإنترنت ، حتى مع نماذج اللغة ، أمر محظور تمامًا. تُخزِّن هذه النماذج بياناتك على خوادم عامة ، ويُؤدي الكشف عن كلمات السر إليها إلى تعريض خصوصيتك للخطر. في حالة اختراق الخادم ، يُمكن للمُتسللين الوصول إلى كلمات السر الخاصة بك واستغلالها من أجل إحداث ضرر مالي.

حدث خرق كبير للبيانات شمل ChatGPT في مايو 2022 ، مما أثار مخاوف جدية بشأن أمان منصات روبوتات الدردشة. علاوة على ذلك ، تم حظر ChatGPT في إيطاليا بسبب اللائحة العامة لحماية البيانات (GDPR) في الاتحاد الأوروبي. اعتبر المنظمون الإيطاليون أنَّ روبوت الدردشة غير مُتوافق مع قوانين الخصوصية ، مما يسلط الضوء على مخاطر انتهاكات البيانات على المنصة. وبالتالي ، يُصبح من الأهمية بمكان حماية بيانات اعتماد تسجيل الدخول من روبوتات الدردشة المدعومة بالذكاء الاصطناعي.

من خلال الامتناع عن مشاركة كلمات السر مع روبوتات الدردشة هذه ، يُمكنك حماية معلوماتك الشخصية بشكل استباقي وتقليل احتمالية الوقوع ضحية للتهديدات الإلكترونية. تذكر أنَّ حماية بيانات اعتماد تسجيل الدخول هي خطوة أساسية في الحفاظ على خصوصيتك وأمانك على الإنترنت. تحقق من أفضل الأدلة المجانية لفهم الأمن الرقمي وحماية خصوصيتك.

5. التفاصيل السكنية والبيانات الشخصية الأخرى

من المُهم أيضًا الامتناع عن مشاركة معلومات التعريف الشخصية (PII) مع روبوتات الدردشة. تشمل معلومات تحديد الهوية الشخصية البيانات الحساسة التي يمكن استخدامها لتحديد هويتك أو تحديد مكان تواجدك ، بما في ذلك موقعك الجغرافي ورقم الضمان الاجتماعي وتاريخ الميلاد والمعلومات الصحية. يجب أن يكون ضمان خصوصية التفاصيل الشخصية والسكنية عند التفاعل مع روبوتات الدردشة أولوية قصوى.

للحفاظ على خصوصية بياناتك الشخصية عند التعامل مع روبوتات الدردشة ، إليك بعض المُمارسات الأساسية التي يجب اتباعها:

- تعرف على سياسات الخصوصية لروبوتات الدردشة لفهم المخاطر المُرتبطة بها.

- تجنب طرح الأسئلة التي قد تكشف عن غير قصد عن هويتك أو معلوماتك الشخصية.

- توخَّ الحذر وامتنع عن مشاركة معلوماتك الطبية مع نماذج الذكاء الاصطناعي.

- ضع في اعتبارك نقاط الضعف المحتملة لبياناتك عند استخدام روبوتات الدردشة المدعومة بالذكاء الاصطناعي على الشبكات الاجتماعية مثل SnapChat.

تحقق من الطرق التي قد تُنظم بها الحكومات أدوات الذكاء الاصطناعي.

تجنب المُبالغة في مشاركة البيانات مع روبوتات الدردشة بالذكاء الاصطناعي

في الختام ، على الرغم من أن روبوتات الدردشة الذكية تُقدم تطورات كبيرة ، إلا أنها تُمثل أيضًا مخاطر خطيرة على الخصوصية. تُعد حماية بياناتك من خلال التحكم في المعلومات المشتركة أمرًا بالغ الأهمية عند التفاعل مع روبوتات الدردشة المدعومة بالذكاء الاصطناعي. كن يقظًا والتزم بأفضل الممارسات للتخفيف من المخاطر المُحتملة وضمان الخصوصية. يُمكنك الإطلاع الآن على أشياء يجب تجنب طلبها من روبوتات الدردشة المدعومة بالذكاء الاصطناعي.