ChatGPT impulsado por IA ha captado la atención del mundo tecnológico, y no faltan desarrollos y actualizaciones. Pero a pesar del uso de tecnología avanzada, existen bastantes factores limitantes en la versión actual.

Uno de esos factores es el sistema de tokenización, que continúa rompiendo el ciclo de desarrollo, causando un impacto negativo en la utilidad proporcionada por el modelo. Si está utilizando ChatGPT, es posible que desee saber acerca de los tokens de ChatGPT y qué hacer cuando se agoten. Verificar Por qué la versión de pago de ChatGPT Professional es inevitable.

Retrocedamos un poco y le daremos una idea de todo lo que hay que saber sobre el funcionamiento básico del modelo.

¿Qué es un token de ChatGPT?

Si revisa la interfaz del formulario, todo lo que ve es un lenguaje informático que obedece sus comandos y le brinda las respuestas que está buscando. Sin embargo, el fondo es mucho código, aprende cada minuto y está preparado para las preguntas que responde rápidamente.

ChatGPT convierte cada palabra en un token cuando haces una pregunta. Para profundizar más, los tokens son fragmentos de texto y cada lenguaje de programación usa un conjunto diferente de valores de token para comprender los requisitos.

Debido a que las computadoras no entienden los valores de texto directamente, los dividen en un conjunto de números, a menudo llamados incrustaciones. Incluso puede pensar en las inclusiones como listas de Python, que son como una lista de números relacionados, como [1.1...n].

Una vez que ChatGPT toma la entrada inicial, intenta predecir la siguiente entrada posible en función de la información anterior. Selecciona la lista completa de tokens anteriores y, utilizando su propia sintaxis de codificación, intenta adelantarse a la entrada posterior del usuario. Utiliza y espera un token a la vez para hacer que el idioma sea más fácil de entender para su uso.

Para mejorar las predicciones y mejorar la precisión, captura la lista completa de inclusiones y las pasa a través de capas de adaptadores para crear asociaciones entre palabras. Por ejemplo, cuando hace una pregunta como "¿Quién es Thomas Edison?" ChatGPT selecciona las palabras más valiosas de la lista: Quién y Edison.

Las capas adaptadoras tienen un papel que desempeñar en todo el proceso. Estas capas son una forma de arquitectura de red neuronal que está entrenada para seleccionar las palabras clave más relevantes de una cadena de palabras. Sin embargo, el proceso de entrenamiento no es tan simple como parece, porque lleva mucho tiempo entrenar capas de adaptadores en gigabytes de datos.

Aunque ChatGPT espera solo un token a la vez, su tecnología de regresión automática está programada para predecir y retroalimentar al modelo base para liberar el resultado. El formulario está configurado para ejecutarse solo una vez por token, por lo que el resultado devuelve una palabra a la vez. La salida se detiene automáticamente cuando el formulario encuentra un comando de token de detención.

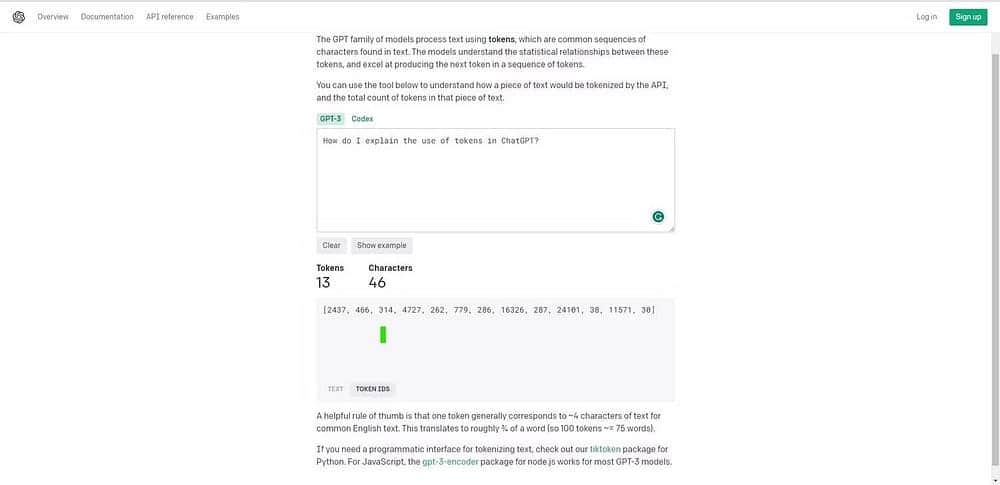

Por ejemplo, si observa la calculadora de tokens en ChatGPT, puede calcular la base para usar el token en sus preguntas.

Entremos en un texto de muestra, como:

¿Cómo explico el uso de tokens en ChatGPT?

Según la calculadora, hay 46 caracteres en esta cadena, que consumirá 13 tokens. Si lo desglosa en identificadores simbólicos, se verá así:

[2437, 466, 314, 4727, 262, 779, 286, 16326, 287, 24101, 38, 11571, 30]

según máquina Calculadora de fichas de OpenAI:

Una buena regla general es que un token generalmente corresponde a aproximadamente 4 caracteres de texto en inglés común. Esto se traduce en aproximadamente ¾ de una palabra (por lo que 100 tokens son ~= 75 palabras).

Comparación de tokens gratuitos y de pago

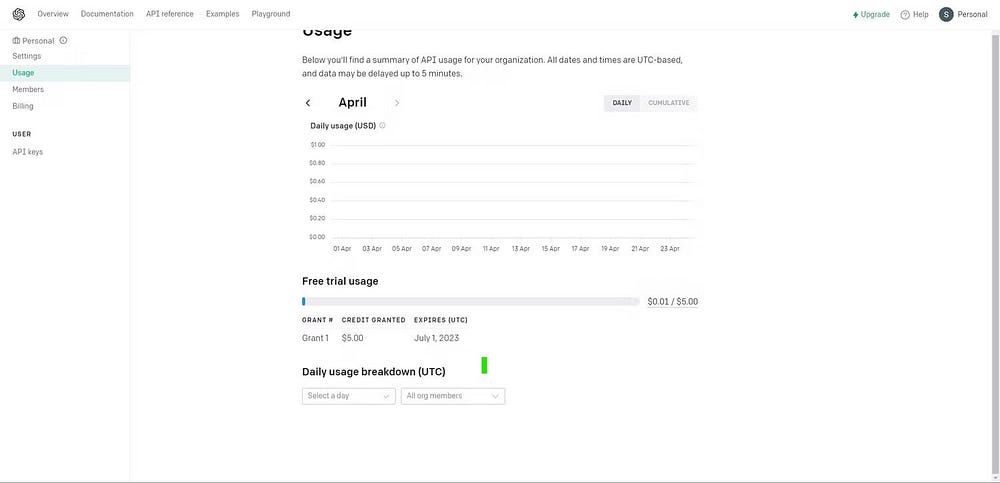

Para darle una idea de lo que hay en el modelo ChatGPT, OpenAI le ofrece una suscripción de token limitada gratuita. Si desea probar la API de ChatGPT, use un crédito gratuito de $ 5, válido por tres meses. Una vez que haya agotado su límite (o su prueba haya expirado), puede pagar sobre la marcha, lo que aumenta la apuesta máxima a $ 120.

ChatGPT Plus: ¿Vale la pena pagar la suscripción?

Para aprovechar los códigos premium, puede suscribirse a la oferta ChatGPT Plus, que cuesta $ 20 por mes. Dado el amplio uso y la popularidad de todo el modelo de IA, estas son las principales características del modelo de suscripción paga:

- Acceso a ChatGPT, incluso si el sitio web está caído debido a la afluencia de usuarios.

- Tasas de respuesta mejoradas.

- Acceso directo a nuevas funciones y lanzamientos.

Si cree que estas funciones valen la pena, puede registrarse para obtener la suscripción paga y aprovecharla de inmediato. Verificar Maneras de controlar ChatGPT con tu voz.

Estructura de precios del token de ChatGPT

Hay algunas plantillas de aplicaciones diferentes disponibles, que puede elegir según sus requisitos:

| Muestra | El precio es por 1000 tokens (reclamo) | El precio es por 1000 fichas (finalización) |

|---|---|---|

| Ada | $0.0004 | $0.0004 |

| Babbage | $0.0005 | $0.0005 |

| Curie | $0.0020 | $0.0020 |

| DaVinci | $0.0200 | $0.0200 |

| ChatGPT | $0.0020 | $0.0020 |

| Contexto GPT-4 8k | $0.0300 | $0.0600 |

| Contexto GPT-4 32k | $0.0600 | $0.1200 |

Ada es el más rápido, mientras que DaVinci es el modelo más poderoso de esta lista de modelos. Prompt es la pregunta, mientras que la finalización se ocupa de las respuestas.

Fichas máximas

Cada formulario le permite establecer el número máximo de tokens por consulta. Este método controla la cantidad máxima de tokens que genera el modelo en una sola solicitud, lo que limita la salida. La función max_token es muy útil, especialmente cuando desea controlar la duración de su salida y evitar el uso excesivo de su token y saldo. La longitud predeterminada se fija en 2048 tokens, mientras que el máximo se puede establecer en 4096 tokens.

ملاحظة: Restringir el uso de tokens puede generar respuestas cortas, lo que puede limitar la producción y distorsionar su experiencia de uso.

El límite superior de ChatGPT3 es 4096; Sin embargo, con la introducción de ChatGPT4, los límites de token aumentan de la siguiente manera:

| Muestra | El precio es por 1000 tokens (reclamo) |

|---|---|

| Ada | 2048 |

| Babbage | 2048 |

| Curie | 2048 |

| DaVinci | 4096 |

| ChatGPT | 4096 |

| Contexto GPT-4 8k | 8192 |

| Contexto GPT-4 32k | 32768 |

Si se suprime su salida, debe aumentar el límite especificado por su tablero. Recuerde que la suma de los tokens de reclamo y máximo siempre debe ser menor que el token de formulario máximo.

Por ejemplo, en el modelo ChatGPT, tokens de reclamaciones + token máximo <= 4096 tokens.

Aprenda a controlar las indicaciones de ChatGPT para obtener los mejores resultados

No importa cómo uses el modelo de IA, es probable que tengas que idear formas de jugar inteligentemente con tus preguntas y frases. Dependiendo de sus patrones de uso, probablemente usará ChatGPT ampliamente para cada tarea.

Para obtener los mejores resultados, debe aprender a manejar la metodología de tokenización y mejorar sus habilidades para garantizar que sus límites de uso sigan siendo los mismos mientras le brinda las mejores respuestas posibles. Puedes ver ahora Algunas formas de aprovechar al máximo ChatGPT.