A tarda notte, i tuoi genitori ricevono un messaggio vocale pieno di panico da parte tua, in cui ti informano che sei nei guai e hai bisogno di aiuto, che il tuo portafoglio è stato rubato e che sei bloccato in un luogo sconosciuto. Il denaro deve esserti trasferito immediatamente in modo che tu possa tornare a casa.

La voce nella lettera sembra molto reale ed è inconfondibilmente la voce di suo figlio, ma non lo è. È un clone vocale AI che è diventato il bersaglio di una truffa tanto sofisticata quanto spaventosamente efficace.

Questo tipo di frode si basa sull'uso di tecniche di intelligenza artificiale per generare voci che sembrano appartenere a familiari o amici in un modo molto simile alle voci reali. Se non rilevati, questi voti falsi possono creare confusione e disinformazione e portare a gravi conseguenze. Pertanto, individuare le frodi legate alla clonazione audio familiare è essenziale per mantenere l’integrità e la sicurezza. Verificare Valutare l'uso della tecnologia di riproduzione del suono nella creazione di contenuti su larga scala.

Come funziona la truffa della clonazione vocale AI?

Le tecnologie di clonazione vocale possono creare copie digitali incredibilmente realistiche della voce di una persona. Questa tecnologia, comunemente chiamata Audio deepfake, utilizzando strumenti di clonazione vocale AI come ElevenLabs (vedere l'esempio di clonazione vocale AI di seguito). In combinazione con l’intelligenza artificiale generativa e la sintesi vocale, la voce clonata può replicare emozioni, sfumature, intonazione e persino paura.

Per riferimento, ecco come suona veramente Christian Cowley, parlando nel podcast Really Helpful.

Per creare una trascrizione AI, è necessario solo un piccolo campione audio, spesso solo un minuto o meno. L'audio viene spesso campionato dai post pubblici sui social media, rendendo vlogger, creatori e celebrità particolarmente vulnerabili perché l'audio nei loro post è di alta qualità e facilmente disponibile.

Una volta che il truffatore ha clonato il campione vocale, utilizza la sintesi vocale o anche la sintesi vocale in tempo reale per creare chiamate e messaggi vocali falsi.

Dopo aver effettuato l'accesso agli account dei social media della vittima e aver raccolto i suoi dati personali, il truffatore crea uno scenario credibile. Potrebbe essere correlato al ricovero in ospedale, all'arresto, alla rapina, al rapimento o a qualsiasi cosa che crei paura e confusione. La voce clonata viene quindi utilizzata per manipolare il membro della famiglia facendogli credere che qualcuno nella famiglia soffre di un problema serio.

Il realismo della voce e delle emozioni, unito allo shock e all’urgenza della richiesta, possono sopraffare lo scetticismo, portando a decisioni affrettate di trasferire denaro o fornire informazioni sensibili.

Perché la truffa della clonazione vocale AI è così efficace?

Come la maggior parte delle truffe rivolte a familiari e amici, la clonazione vocale tramite intelligenza artificiale è efficace perché sfrutta le connessioni personali. Il panico nel ricevere una chiamata di soccorso da un membro della famiglia può rapidamente offuscare la capacità di giudizio, portando a decisioni avventate. È la stessa tattica utilizzata nelle truffe legate al baratto, ma l'effetto aumenta quando senti la voce di qualcuno vicino a te.

I familiari di coloro che hanno una vasta presenza sui social media o di coloro che viaggiano sono particolarmente a rischio perché le loro situazioni forniscono un contesto plausibile per la narrativa inventata del truffatore. Il truffatore spesso raccoglie e utilizza in anticipo i dati privati dei suoi obiettivi dai loro account pubblici sui social media, il che rende le storie più convincenti. Verificare Come affrontare la minaccia di rapimento virtuale e proteggersi online? Riconoscere le minacce.

Segni chiave di una truffa sulla clonazione vocale dell'IA

Nonostante la sua complessità, la clonazione vocale dell’IA può rivelarsi attraverso specifici segnali di allarme:

- Urgenza: Il truffatore cercherà di convincerti che accadrà qualcosa di terribile se non si interviene immediatamente.

- i fatti: Il truffatore non sempre conosce tutta la storia dietro la tua relazione con la vittima, quindi presta attenzione alle incongruenze.

- Richieste insolite: Le richieste di trasferimento di fondi su conti bancari all'estero o di pagamento su un portafoglio di criptovaluta sono metodi comuni.

Questi fattori sono difficili da prendere in considerazione di fronte a uno scenario terribile, ma potrebbero impedirti di essere truffato.

Cosa fare se sospetti una truffa sulla clonazione vocale dell'IA

Se ricevi una chiamata o un messaggio vocale da una persona cara in difficoltà, mantieni la calma. Il truffatore cercherà di farti prendere dal panico e farti emozionare, perché questo aumenta la probabilità che tu sia esposto ai suoi metodi.

Se ricevi una telefonata

Se sospetti, anche per un secondo, che una chiamata possa essere una truffa di clonazione vocale, riattacca immediatamente. Non condividere alcuna informazione e non fare affari con i truffatori. Richiama invece i tuoi cari a un numero noto per confermare l'autenticità della chiamata di soccorso.

Conversare ulteriormente con il truffatore potrebbe anche comportare il rischio che la tua voce venga registrata e clonata.

Se ricevi un messaggio vocale

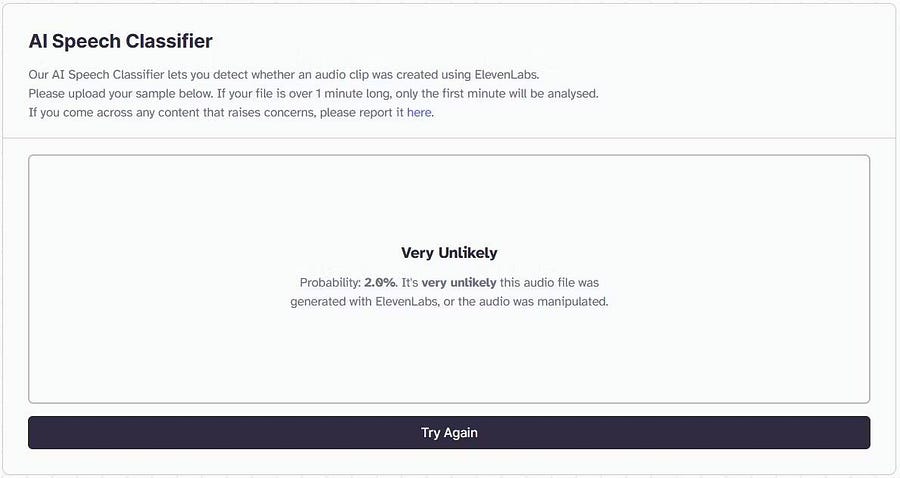

Se il truffatore lascia un messaggio vocale, salva immediatamente l'audio sul tuo telefono o laptop. Questo campione di audio può essere utilizzato in un classificatore vocale AI per determinare se si tratta di una voce umana. I classificatori vocali basati sull'intelligenza artificiale funzionano proprio come l'hardware Rilevamento della digitazione tramite intelligenza artificiale. Inserisci semplicemente il file audio e il classificatore lo contrassegnerà come generato dall'uomo o dall'intelligenza artificiale.

Un ottimo strumento per eseguire questo controllo è ElevenLabs Speech Classifier. ElevenLabs è alla base della maggior parte delle piattaforme di clonazione vocale AI, quindi è uno strumento ideale per determinare se una voce è stata clonata. Ecco come utilizzarlo per identificare l'audio riprodotto dall'intelligenza artificiale:

- ال لى Classificatore vocale ElevenLabs.

- Carica un messaggio vocale di esempio e fai clic su "Rileva discorso sintetizzato".

Nell'esempio seguente, un messaggio di soccorso è stato registrato da qualcuno e caricato nella cartella di lavoro. Puoi vedere che è contrassegnato con una probabilità del 2% di essere manomesso.

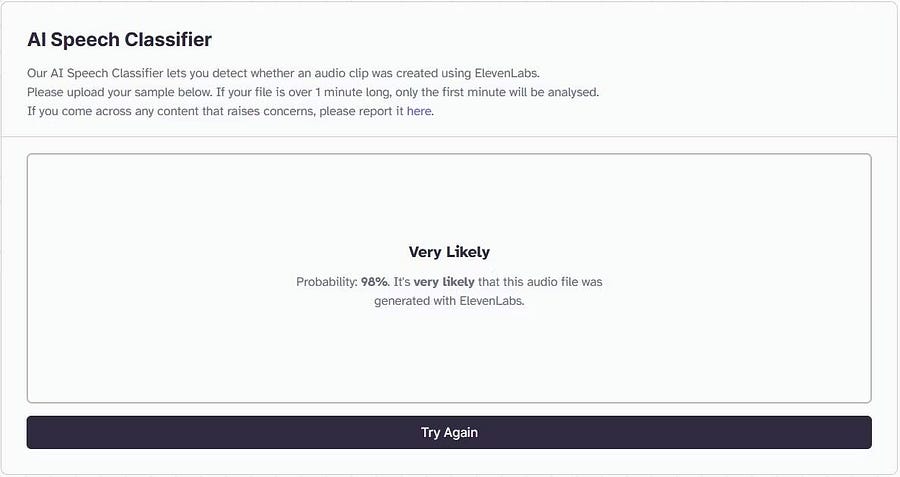

Nell'esempio seguente, lo stesso messaggio di soccorso è stato prodotto utilizzando uno strumento di clonazione vocale AI. Per l’orecchio umano i suoni sono indistinguibili. Tuttavia, lo strumento ha valutato che ha una probabilità del 98% di essere generato dall’intelligenza artificiale.

Anche se non puoi fare affidamento al 100% su questo libro di esercizi, può confermare i tuoi sospetti sull'utilizzo dell'audio clonato. Dovresti anche chiamare la persona amata su un numero noto per confermare. Verificare Le capacità umane o l’intelligenza artificiale sono superiori nel rilevare la tecnologia deep fake?.

La prevenzione è la migliore difesa contro le truffe legate alla clonazione vocale dell’IA

A volte, la migliore difesa contro le truffe ad alta tecnologia sono le soluzioni a bassa tecnologia.

Crea una password offline conosciuta solo dai tuoi cari, familiari e amici. Se stai effettuando una chiamata in situazioni critiche, l'utilizzo di questa password può essere un modo sicuro per confermare l'identità del chiamante.

Infine, tenere le tue informazioni private lontane dai siti di social media è un grande passo avanti per garantire che i truffatori non riescano a raccogliere informazioni sufficienti per costruire una storia. Ricorda: se non vuoi che tutti lo sappiano, è meglio non condividerlo sui social media. Puoi visualizzarlo ora Qual è il valore dei dati del tuo account social nel dark web?