روابط سريعة

يُعد الذكاء الاصطناعي (AI) أحد أكثر التقنيات إثارةً للاهتمام في العالم اليوم.حيث لديه القدرة على تحسين حياتنا بعدة طرق ، من مُساعدتنا في مهامنا اليومية إلى تحسين الرعاية الصحية والتعليم. ومع ذلك ، فإنَّ الذكاء الاصطناعي يُثير أيضًا مخاوف بشأن الخصوصية.

انظر حولك ؛ البيئة مليئة بالذكاء الاصطناعي وإمكانياته شبه المُستحيلة. والذي يُمكِّن الكمبيوتر أو الآلة من التفكير والتعلم والتصرف بذكاء ، مثل الإنسان.

في الواقع ، تنتشر تقنيات الذكاء الاصطناعي التوليدي مثل ChatGPT في كل صناعة تقريبًا — من الرعاية الصحية ، والخدمات المصرفية ، والتصنيع إلى الفنون الإبداعية وتطبيقات المُستهلك. تحقق من الآثار الصحية السلبية المُحتملة لتكنولوجيا الذكاء الاصطناعي التوليدي.

يجمع الذكاء الاصطناعي كميات هائلة من البيانات حولنا. يُمكن استخدام هذه البيانات لإنشاء ملفات تعريف شخصية ، والتي يُمكن استخدامها لتحديد أهدافنا وسلوكياتنا. يُمكن استخدام هذه المعلومات لأغراض تسويقية أو حتى لأغراض ضارة، مثل التنمر أو المُطاردة عبر الإنترنت.

إذا خطرت في ذهنك أفكار مُماثلة ، فإنَّ مخاوفك المُرتبطة بالخصوصية فيما يتعلق بالذكاء الاصطناعي أمر طبيعي. تُعتبر خصوصيتك أكثر أهمية الآن من وقت مضى في هذا العصر الرقمي المُتنامي.

ما هي مخاطر الخصوصية المُرتبطة بالذكاء الاصطناعي؟

وفقًا لاستطلاعات Pew Research ، يُطلب من واحد من كل أربعة أمريكيين المُوافقة على سياسة الخصوصية كل يوم. ومع ذلك ، فإنَّ 22% فقط يقرؤون فعليًا سياسات الخصوصية في مُجملها.

لنفكر في خدمات الذكاء الاصطناعي مثل ChatGPT و Google Cloud AI و Jupyter و Viso Suite و Chrorus.ai التي تنص سياسات الخصوصية الخاصة بها على أنها تجمع معلوماتك الشخصية والمحتوى الذي تُشاهده أو تتفاعل معه ، بل وحتى مصدر البيانات من منصات التواصل الاجتماعي وقواعد البيانات العامة.

علاوة على ذلك ، يتم استخدام بياناتك لتدريب نماذج الذكاء الاصطناعي الخاصة بها.

لذلك قد تستمتع بكتابة رسائل البريد الإلكتروني وإنشاء العروض التقديمية في ثوانٍ ؛ والدردشة مع روبوت خدمة العملاء ؛وتجربة الإكسسوارات أثناء التسوق افتراضيًا ؛ أو مجرد Google ، حيث تتبعك الإعلانات القائمة على الاهتمامات في جميع أنحاء الويب.

يتم تشغيل هذه العمليات من خلال بياناتك التي يتم جمعها كل دقيقة. إذا كنت تعتبر أنَّ الذكاء الاصطناعي ينتهك خصوصيتك ، فأنت لست مُخطئًا.

بينما تدَّعي شركات الذكاء الاصطناعي أنَّ معلوماتك آمنة ، أدَّت العديد من خروقات البيانات من قبل مُجرمي الإنترنت إلى سرقة الهوية والخسارة المالية والإضرار بسمعة الضحايا في جميع أنحاء العالم.

تظهر نتائج بحث Global Data Breach Stats من Surfshark أنَّ الولايات المُتحدة لديها أكثر من 2.6 مليار سجل مكشوف من خلال خروقات البيانات منذ عام 2004.

ويتم تدريب معظم نماذج الذكاء الاصطناعي على مجموعة بيانات كبيرة من مصادر عامة ، ومعظمها مُتحيز. يمكن أن يؤدي هذا التحيز إلى عواقب وخيمة ، مثل انتهاك حقك في الخصوصية.

الآثار القانونية والأخلاقية للخصوصية في عصر الذكاء الاصطناعي

هل تنطبق قوانين الخصوصية الخاصة بنا على الذكاء الاصطناعي؟ وفقًا للبودكاست الخاص بنقابة المحامين الأمريكية حول تنظيم الذكاء الاصطناعي في الولايات المتحدة ، في الوقت الحالي ، لا يوجد تشريع فيدرالي شامل مُخصص فقط لتنظيم تقنيات الذكاء الاصطناعي.

أقر الاتحاد الأوروبي قانون الذكاء الاصطناعي ، والذي بموجبه ستزيد اللوائح بما يتناسب مع التهديد المُحتمل للخصوصية والأمان الذي يُشكله نظام الذكاء الاصطناعي. نأمل أن يُحفز هذا القانون الولايات المتحدة والمملكة المتحدة ودول أخرى على تمرير قوانينها أيضًا.

ومع ذلك ، فإنَّ تنظيم الذكاء الاصطناعي وحماية الخصوصية يفرضان العديد من التحديات لأنَّ خوارزميات الذكاء الاصطناعي مُعقَّدة.

ثانيًا ، معظم قوانين الخصوصية الحالية مُتجذرة في نموذج الإشعار والموافقة لاختيار المُستهلك. سياسات الخصوصية هي مثال ، يُوافق عليها العملاء ولكن نادرًا ما يقرأونها بالكامل.

أيضًا ، قد يقوم الأفراد المُتحفزين لثورة الذكاء الاصطناعي بالإفصاح عن معلومات خاصة عن طيب خاطر ، مما يُؤدي إلى إفشال الغرض من ضمان خصوصية البيانات بعيدًا عن الذكاء الاصطناعي.

من الناحية المثالية ، يجب أن يكون مُستقبلنا الجديد الذي يُحركه الذكاء الاصطناعي أيضًا مدفوعًا بالأخلاقيات لحماية خصوصية بياناتنا. يجب أن تكون آمنة وعادلة وغير متحيزة ومُفيدة للجميع. يجب على المُبدعين والمطورين تدريب نماذج الذكاء الاصطناعي باستخدام بيانات متنوعة.

لكسب ثقتنا ، يجب أن تكون نماذج الذكاء الاصطناعي شفافة بشأن القرارات التي يتم اتخاذها باستخدام مُختلف البيانات. ومع استبدال الذكاء الاصطناعي لقوى عاملة كبيرة بالفعل ، يجب أن يؤدي تطوير الذكاء الاصطناعي إلى خلق وظائف أفضل. تحقق من الطرق التي قد تُنظم بها الحكومات أدوات الذكاء الاصطناعي.

حماية الخصوصية في عالم يُحركه الذكاء الاصطناعي

يجب أن يكون لديك خيار مشاركة البيانات الشخصية التي تُريدها. ويجب على شركات الذكاء الاصطناعي وضع تدابير مُحسَّنة لحماية البيانات لضمان بقاء معلوماتك آمنة وخصوصية.

يجب دمج مبادئ الخصوصية حسب التصميم في جميع العمليات وفي جميع الأنشطة والمعالجة ، وبالتالي ضمان حماية خصوصية البيانات طوال دورة حياة نظام الذكاء الاصطناعي.

علاوة على ذلك ، يجب أن تحكم القوانين واللوائح الصارمة نماذج الذكاء الاصطناعي وتُقيِّد شركات الذكاء الاصطناعي على الإلتزام بها.

في أول معيار عالمي على الإطلاق طورته اليونسكو ، يُعد الحق في الخصوصية وحماية البيانات من بين المبادئ الأساسية العشرة لهذه التوصية لبناء تقنيات الذكاء الاصطناعي. تحقق من طرق منع الهلوسة لدى نماذج الذكاء الاصطناعي.

دورك في حماية خصوصيتك

وفقًا لاستبيان Attitudes Towards Privacy Survey 2022 من Surfshark ، وافق 90% من مُستخدمي الإنترنت على أهمية الخصوصية على الإنترنت بالنسبة لهم. وذكر 32% أنَّ جودة الخدمات أهم من الخصوصية.

إذا كان يجب عليك استكشاف أحدث تقنيات الذكاء الاصطناعي للعمل بشكل أسرع ، فابحث عنها. لكن خذ بضع دقائق لقراءة سياسة الخصوصية الخاصة بها. وابحث عن إلغاء الاشتراك في مشاركة البيانات.

ابدأ في إدارة خصوصيتك مع الجهاز الذي في يدك أو على الكمبيوتر الخاص بك. استخدم VPN للتصفح وقم برفض أذونات التخزين للتطبيقات التي لا تستخدمها.

هل تعلم أنه يُمكنك تنظيف بصمتك الرقمية بانتظام؟ وإلغاء الاشتراك في قواعد بيانات وسطاء البيانات الذين يجمعون معلوماتك الشخصية؟ تحقق من هل تحتاج إلى VPN للحفاظ على خصوصية نشاطك على الإنترنت وأمانه؟

استعد خصوصيتك باستخدام Incogni

يبحث وسطاء البيانات دائمًا عن سرقة معلوماتك الشخصية من السجلات العامة ومن خلال عادات تصفحك. إذا كنت قد جربت نظارة شمسية افتراضيًا ، فسيكون وجهك موجودًا في قاعدة بيانات أيضًا.

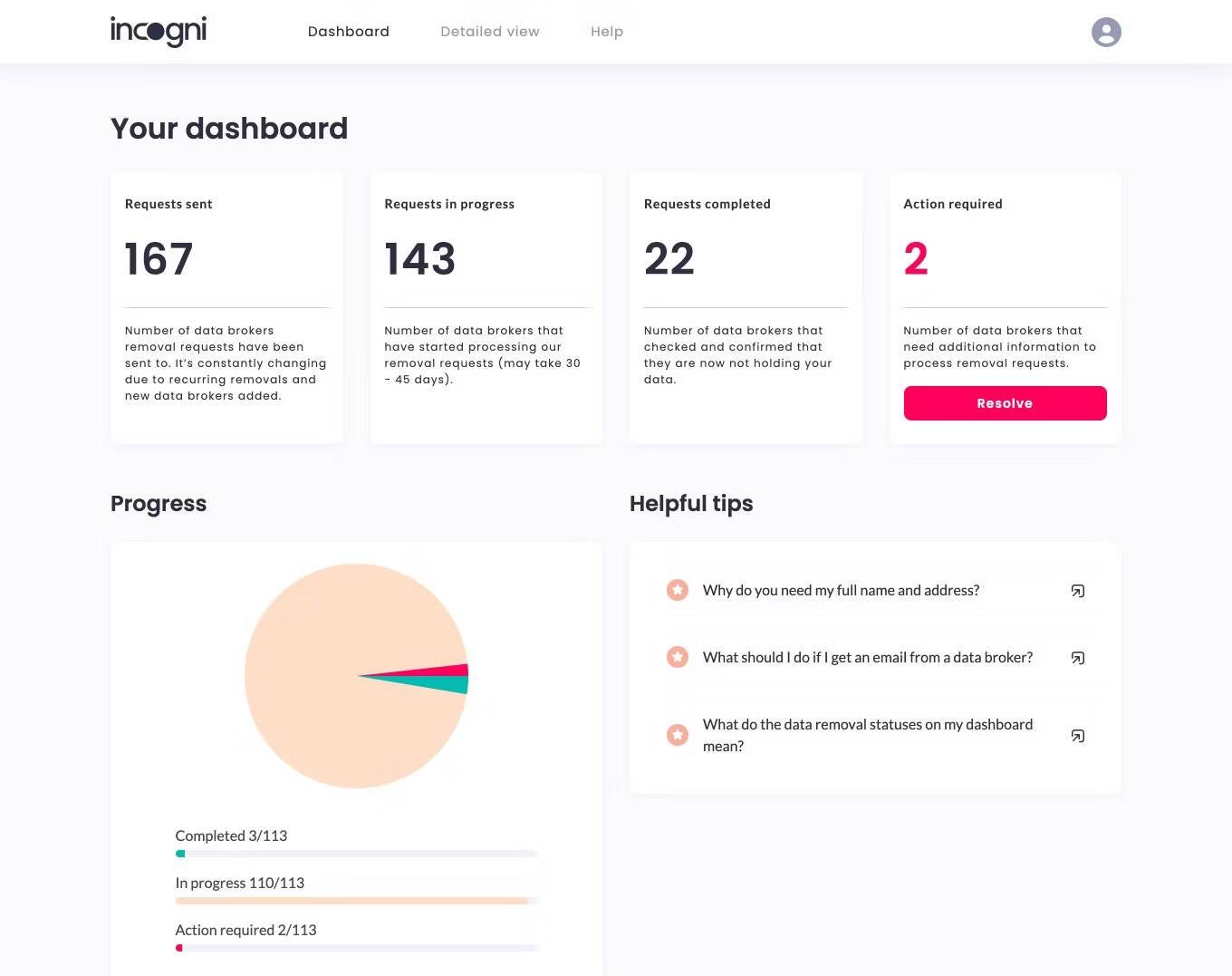

يسرد Incogni وسطاء البيانات الذين من المُحتمل أن يكون لديهم معلومات العملاء ، مثل رقم الضمان الاجتماعي أو العنوان الفعلي أو المعلومات الصحية أو رقم الهاتف أو عنوان البريد الإلكتروني. تُباع هذه البيانات لشركات الاستثمار أو الرعاية الصحية أو المالية أو التسويق أو التوظيف. أو تُستخدم لخداعك أو لمحاولة تعرضيك لهجمات التصيد.

كل هذا يمكن أن يؤدي إلى ظهور إعلانات غير مرغوبة ، والتأثير على أهليتك للقرض أو معدلات التأمين ، وزيادة مخاطر الهجمات الإلكترونية.

لكن Incogni يُرسل طلبات إزالة البيانات إلى وسطاء البيانات نيابة عنك ، حتى بعد حذف بياناتك ، سيبدأ وسطاء البيانات في جمع معلوماتك مرة أخرى.

يمكنك مراقبة العملية وعرض قواعد البيانات المحتملة التي تم العثور عليها والطلبات المرسلة والطلبات المكتملة على لوحة معلومات Incogni سهلة الاستخدام.

يُمكنك استعادة خصوصيتك الآن عن طريق الحصول على اشتراك ؤلمدة عام بخصم 50% — مقابل 6.49 دولارًا فقط شهريًا — والحفاظ على بياناتك خارج السوق وآمنة. تحقق من لماذا لا يجب أن تثق في ChatGPT لمُشاركة المعلومات السرية معه.

الذكاء الاصطناعي وخصوصيتك: الحاجة إلى توازن ثوري

مما لا شك فيه أنَّ هذا المستقبل الجديد للذكاء الاصطناعي عرضة لمخاطر الخصوصية ، مما يجعل معالجتها أمرًا مُهمًا. ويمكن أن يكون Incogni مخرجًا.

في الواقع ، بدأت عجلة التغيير لتنظيم شركات الذكاء الاصطناعي وحماية خصوصيتك وإنشاء لوائح مُخصصة في الظهور. نأمل أن تكتسب زخمًا لتُصبح ثورة مثل الذكاء الاصطناعي — وتُلبي الحاجة إلى نهج متوازن لتطوير الذكاء الاصطناعي وحماية الخصوصية. يُمكنك الإطلاع الآن على هل لدى ChatGPT مُشكلات تتعلق بالخصوصية؟